Non dare i permessi di root allo stagista (o un Mac Mini)

Per capire il caos di questa settimana nel mondo AI, bisogna prima capire cos'è OpenClaw.

È nato come la risposta open-source agli agenti proprietari dotati di "Computer Use". La promessa era inebriante: un agente autonomo, self-hosted, capace di navigare sul web, cliccare pulsanti e usare il terminale esattamente come un umano. Era il sogno di liberarsi dai walled garden di OpenAI o Anthropic, per avere un lavoratore che vivesse sulla tua infrastruttura.

Ma come accade per ogni adozione tecnologica rapida, il "cool factor" ha superato il "security factor".

Questa settimana è stata un bagno di sangue. Stiamo vedendo centinaia di istanze OpenClaw esposte apertamente su internet. Dump di credenziali. Chiavi API in chiaro. Significa che terze parti possono fare praticamente ciò che vogliono con i tuoi dati privati.

Il fraintendimento fondamentale non riguarda il codice, ma l'architettura. Pensi di essere l'unico input per il tuo agente. Non è così. Un agente è un motore di ingestione. Ogni email che legge, ogni pagina web che visita: è tutto contenuto scritto da qualcun altro.

Se una persona a caso ti manda un DM, quel messaggio non è più solo testo. Diventa un input per un sistema che spesso ha accesso alla shell della tua macchina. Si chiama "Indirect Prompt Injection" e trasforma il tuo inbox, di fatto, in una riga di comando per sconosciuti.

L'epidemia dei Mac Mini

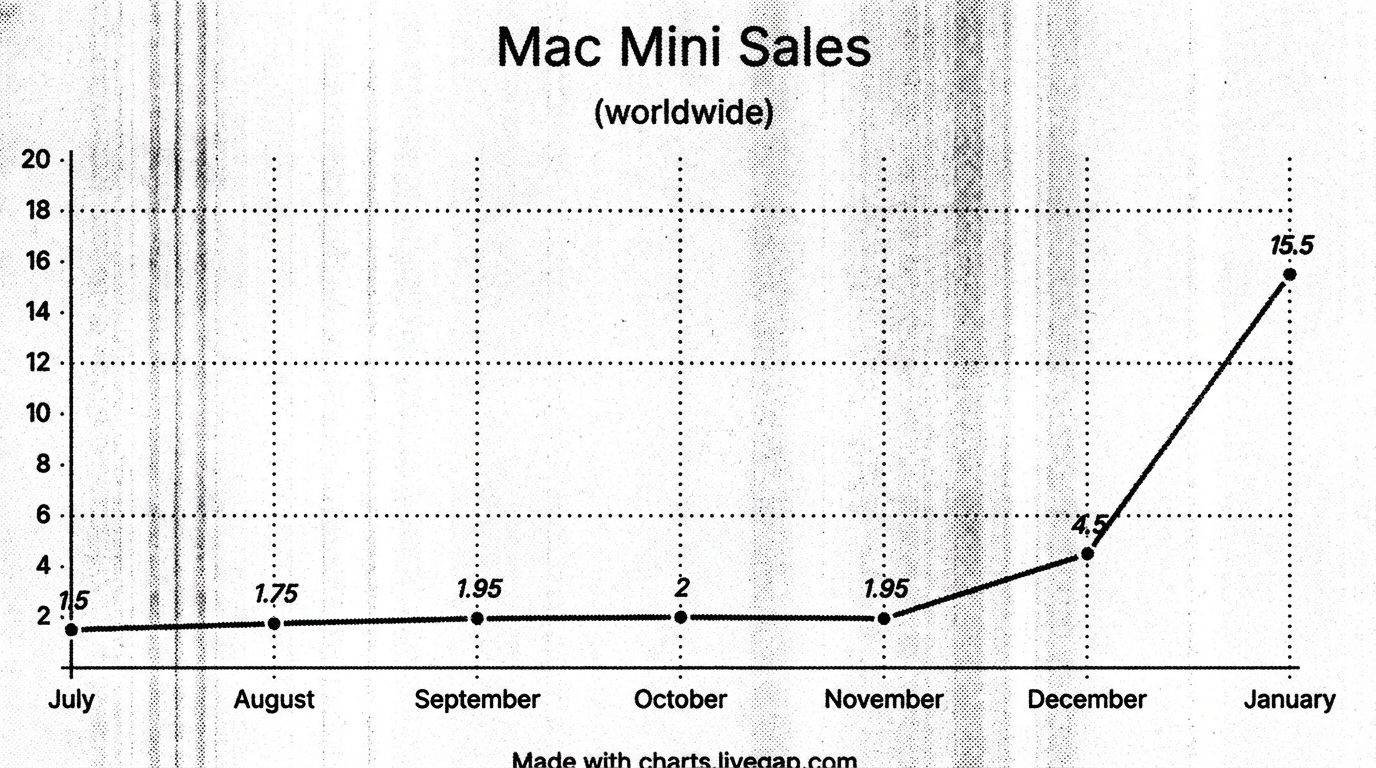

C'è una strana epidemia in corso: gente che compra Mac Mini solo per far girare uno script Python.

Non ti serve una macchina consumer da oltre 800€ sulla scrivania per fare chiamate API. È uno spreco di silicio ed elettricità. Un agente dovrebbe essere un processo background headless, non un animale domestico da scrivania.

Il mio stack personale gira su un Raspberry Pi 5. Se ne sta lì tranquillo, consuma quanto una lampadina e fa esattamente quello che fa il Mac Mini: sposta JSON avanti e indietro. Se non vuoi hardware fisico, usa una VPS da 5€ o il tier gratuito di AWS. Ma per favore, smettetela di comprare computer desktop per dei background worker.

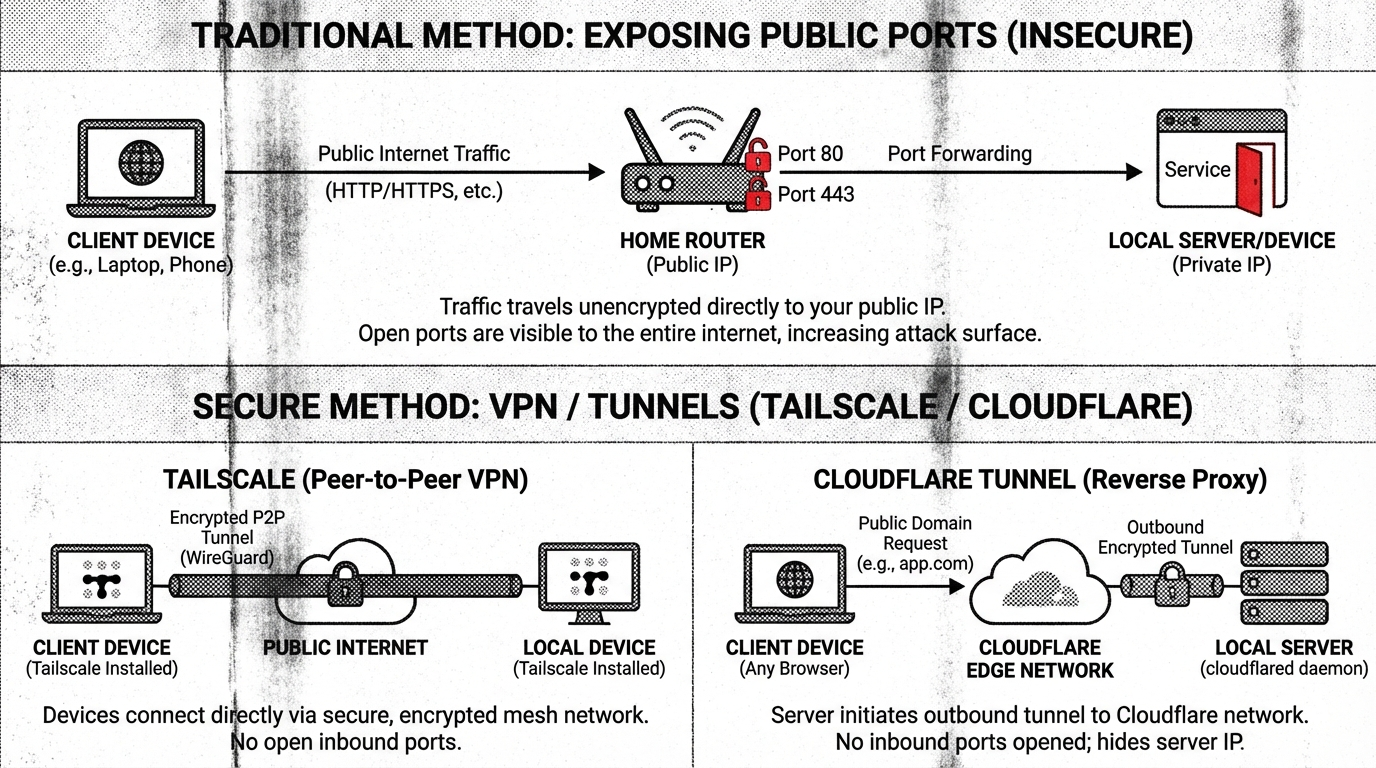

L'Architettura: Identità e Isolamento

Se hai intenzione di implementare questo sistema, tratta l'agente come se fosse uno stagista esterno. Non daresti mai a uno stagista estivo il tuo laptop sbloccato e le tue credenziali Google principali. Non dovresti darle nemmeno al tuo agente.

- Identità: L'agente ha bisogno del proprio account Google, del proprio calendario e del proprio set di permessi per ogni servizio a cui accede. Se viene compromesso, bruci l'identità dell'agente, non la tua.

- Segmentazione: Non farlo girare direttamente sul tuo OS (bare metal). Usa Docker.

- Rete: Non esporre mai le porte all'internet pubblico.

- Tailscale è il modo più semplice per accedervi in sicurezza.

- Cloudflare Tunnels sono la scelta professionale se ti serve un controllo granulare senza aprire porte sul router.

Human in the Loop (HITL)

Costruisco sistemi automatizzati per le aziende per lavoro. La complessità non sta tanto nel far funzionare il sistema, ma nel renderlo sicuro.

Spesso colleghiamo questi agenti a sistemi RAG (Retrieval-Augmented Generation) e a enormi knowledge base. Ma per quanto buono sia il contesto, l'output di un LLM è probabilistico, non deterministico.

Ecco perché serve uno Human in the Loop. Non puoi automatizzare ciecamente decisioni critiche basandoti su un sistema che prevede il token successivo in base alla probabilità statistica.

C'è una questione più profonda qui, che riguarda la natura di "Black Box" dell'AI e come questa eroda le nostre capacità di pensiero critico. Ci fidiamo dell'output perché sembra sicuro di sé, anche quando il percorso logico è nascosto. Ma questo è un argomento per un'altra nota.

Per ora, limitatevi a chiudere a chiave le porte. Mettete in sicurezza la rete, segmentate i permessi e spendete i vostri soldi in hardware in modo intelligente.

E se state implementando tutto questo per la vostra azienda, scegliete il vostro consulente AI con saggezza. State pagando per l'architettura, non per lo script di installazione.

;)